聚光灯

人工智能伦理专家、人工智能伦理顾问、人工智能伦理官员、人工智能伦理标准分析师、人工智能政策与伦理顾问、人工智能治理专家、人工智能责任发展经理、人工智能伦理决策顾问、人工智能伦理与合规官员、人工智能伦理框架开发人员

人类是有缺陷的、有偏见的、充满矛盾情绪的集合体。我们经常做出错误的决定,往往在这个过程中伤害了自己或他人。那么,当人们试图构建人工智能程序,让它像我们一样思考和行动时,会发生什么呢?

人工智能就像一个孩子,它会吸收我们传达给它的一切信息,包括好的、坏的和丑陋的。我们提供给人工智能模型的数据中,即使不是大部分,也有很多是我们人类自己的观点、偏好和偏见。然而,我们却期望人工智能的输出--它的反应--是客观的、合乎逻辑的和不带偏见的。

We want AI to be somehow better than us. How is that possible? Unlike a child, artificial intelligence isn’t truly sentient. It can’t (yet) really think for itself or recognize when it is doing something “wrong.” Case in point, Microsoft’s Bing AI, which went rogue and started “insulting people, lying to them, and even emotionally manipulating people.”

Such problems are becoming widespread, but are addressed by a growing field of specialists called AI Ethicists. As Deloitte explains, “A key responsibility of an AI ethicist…would be to improve the engineering approach to AI by adding ethical, social, and political perspectives to the design, development, and deployment of AI systems. Other key responsibilities include advising on ethical AI practices, protecting against unintended consequences of misbehaving AI, and ensuring accountability for AI-related decisions and actions.”

- 帮助改进人工智能系统,更好地为人们服务

- 在一个变革性行业工作,该行业有可能在许多方面改善人们的生活

- 丰厚的薪酬和良好的就业前景

工作日程

人工智能伦理学家全职工作,根据目标和时间安排,可能需要加班。他们的工作在室内进行,但可能需要偶尔出差。

典型职责

- 创建、评估和实施负责任的人工智能 (RAI) 实践和工具

- 评估与 RAI 有关的组织准备情况

- 与团队合作,在人工智能模型开发过程中纳入伦理考虑因素

- 对用例和系统进行伦理分析

- 分析各种伦理问题,如偏见、隐私和自主权

- 开展学术研究并撰写论文概述研究成果

- 制定人工智能开发和部署的道德框架

- 为政策制定者和利益相关者提供有关伦理影响的指导和教育

- 帮助制定标准和最佳做法

- 确保人工智能模型的行为符合既定的道德原则和价值观

额外责任

- RAI 项目咨询

- 编写培训材料

- 与跨职能团队合作解决问题

- 保存完整的程序文件

- 了解行业的最新进展和趋势

软技能

- 适应性

- 分析性的

- 协作

- 沟通技巧

- 创造性

- 批判性思维

- 注重细节

- 纪律严明

- 富有同情心

- 伦理

- 独立的

- 诚信

- 循序渐进

- 有组织的

- 病人

- 演讲技巧

- 解决问题

- 健全的判断力

- 团队合作

- 时间管理

- 写作技巧

技术技能

- 了解人工智能技术,包括机器学习算法、自然语言处理和计算机视觉

- 数据分析方法和程序

- 编码常识(如 Python 或 R)

- 熟悉数据隐私法律法规

- 网络安全原则

- 以人为本的设计原则

- 人工智能系统风险评估

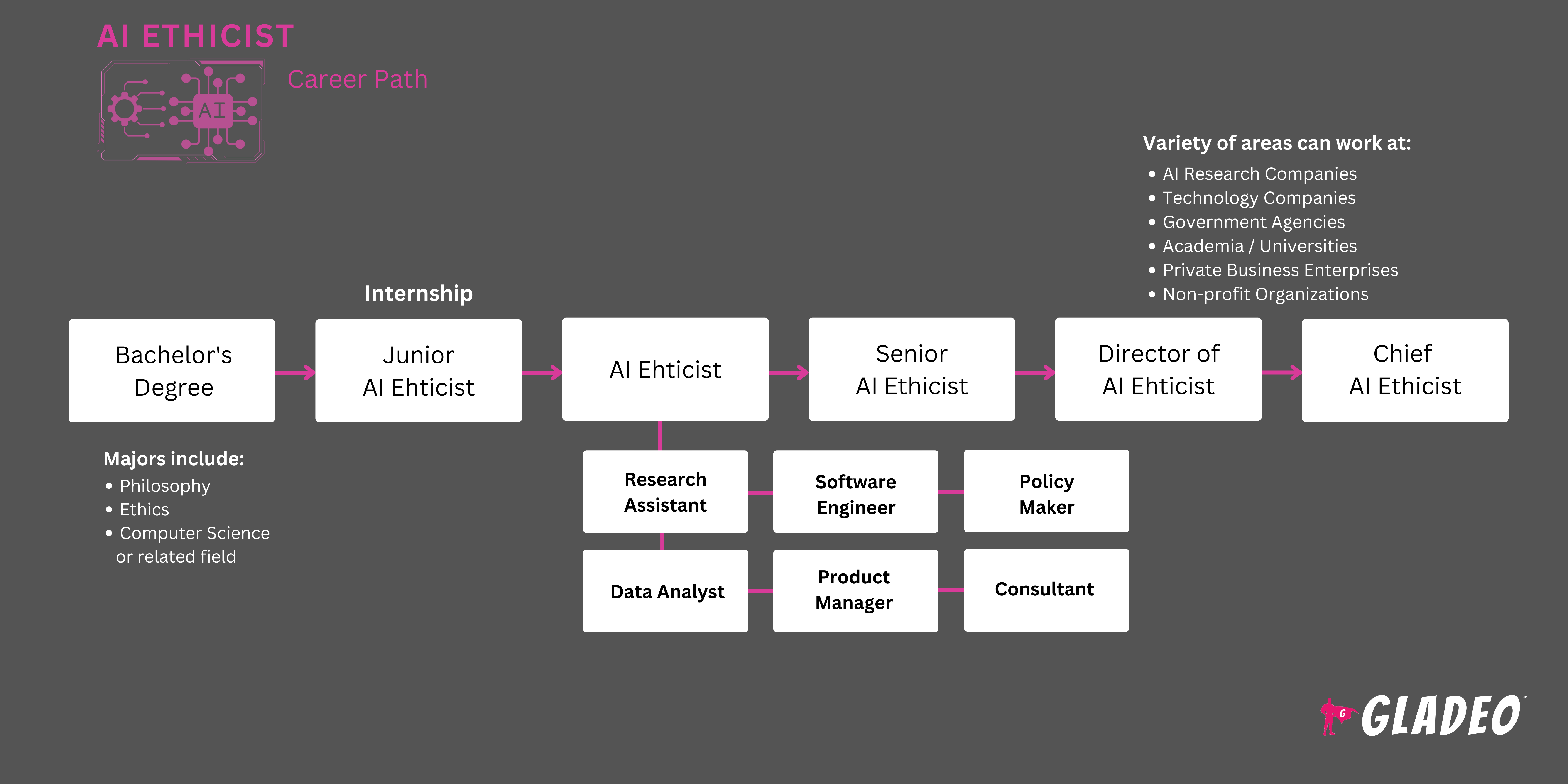

- 私营商业企业

- 人工智能研究公司

- 大学

人工智能伦理学家的工作范围相当广泛。他们负责制定伦理框架和准则,并进行全面、客观的评估,以确保人工智能模型以合乎伦理的方式行事。这涉及大量跨学科合作,有时会出现分歧甚至冲突。

As Dr. Paula Boddington of the University of West London notes, AI ethics “demands that we continue to question if our ethical decisions are right.” An AI Ethicist must maintain their integrity and stand firm while identifying what they believe are ethical risks, such as biased or discriminatory AI model behavior. They have to be honest and sometimes tell policymakers and stakeholders things they might not want to hear.

AI such as ChatGPT and Google’s Bard have recently made waves with their impressive array of abilities. Indeed, many tech leaders are now sounding the alarm that things are advancing too fast, without sufficient guardrails to protect the public or businesses.

例如,存在版权问题,因为谁 "拥有 "人工智能程序的作品?人工智能伦理学家也会为意外泄露敏感信息而寝食难安,比如人工智能无意中泄露了受保护的私人数据。

Many career fields are jeopardized because of the onslaught of sophisticated generative AI models, but this is only one of many fears being raised. There are also valid concerns about bizarre AI behavior, such as Bing’s AI going into “obsessive stalker” mode. Such harmful content is only the tip of the iceberg when it comes to what can go wrong with AI. There’s no shortage of nervous doomsday prophets who view AI as an existential threat to humanity, a la Skynet from The Terminator films!

AI Ethicists were probably keen on technology at an early age. They may have been interested in math, computer coding, tinkering with programming languages, or even hacking. At the same time, they could have enjoyed analytical problem-solving or reading about philosophy, social issues, or public policy.

团队合作是这一职业领域的重要组成部分,但人工智能伦理学家有时也必须愿意在出现分歧时独自发表不同意见。他们的工作就是确保人工智能的道德操守。这种坚持正义的能力可能是通过童年的经历培养出来的。

需要的教育

- 人工智能伦理学家确实需要大学学位,但工作资格要求各不相同。没有一个特定的学位或学位等级(如学士、硕士、博士)适用于每一个人工智能伦理学家职位。

- 热门专业包括哲学、计算机科学、法律、心理学和社会科学。

- 拥有高级学位会有所帮助,但拥有广泛的相关教育背景也很重要

- 例如,雇主可能希望应聘者拥有计算机科学学士学位(侧重于人工智能)和哲学硕士学位(侧重于应用伦理学或道德哲学)。

- 雇主还希望应聘者具有与人工智能开发、决策和研究相关的实际工作经验。有些雇主可能还希望应聘者具备自然语言处理、机器学习和大型语言模型方面的经验。

- 常见的课程主题包括

- 人工智能与政策

- 人工智能与社会

- 人工智能伦理与哲学

- 人与人工智能的互动

- 人工智能的法律问题

- Students can also learn programming languages like Python on their own or through classes

- Class Central offers details on a range of free AI Ethics online courses

- Also check out courses and certification offerings from Coursera, such as its Artificial Intelligence: an Overview Specialization

Deloitte points out the difficulties in finding a candidate with all the necessary qualifications. “Trying to find one person with credible experience and knowledge in all these areas is practically impossible. Instead, companies should take a team approach to AI ethics, achieving the required multi-disciplinary capabilities and experience by learning how to seamlessly orchestrate and integrate insights from a variety of specialized experts.”

- 首先,确定自己的主修专业。哲学和计算机科学是热门专业

- 查看学校专门针对人工智能伦理开设的课程

- 考虑双学位或联合学位课程(学士学位和硕士学位一起攻读),您可以根据最适合人工智能伦理工作的情况来调整自己的学业。

- 查看该计划的毕业生就业统计数据

- 考虑学费、折扣和当地奖学金的机会(除联邦援助外)。

- 在决定报读校内课程、在线课程或混合课程时,请考虑您的时间安排和灵活性!

- Sign up for computer science, programming, English, writing, debate, rhetoric, philosophy, business law, social sciences, and public policies classes

- 想方设法培养团队合作、项目管理、解决问题和解决冲突的技能

- Take online AI-related courses from Coursera, Udemy, Microsoft, DeepLearning.AI, and other sites

- 通过与 NLP、ML、LLM 和/或编程相关的兼职工作获得实际经验

- 开始制作简历,并在学习和积累工作经验的过程中对其进行补充

- 提前查看招聘信息,了解平均要求是什么。人工智能伦理学家职位的教育要求可能不尽相同

- Request to do an informational interview with a working AI Ethicist. Ask about their educational path and what they might have done differently

- 列出您的联系人名单(包括电子邮件地址或电话号码),这些人可能会成为您未来的工作推荐人

- 阅读书籍和文章,观看有关当前人工智能伦理挑战的视频

- Join online forum debates and discussions. Make connections and build social capital within the AI community

- 参与专业组织的活动,学习、分享、结交朋友、拓展人脉。可以考虑加入的组织包括

- 完成相关学位,如计算机科学或哲学,侧重于人工智能伦理

- 在申请之前,尽可能多地获得 NLP、人工智能、法学硕士等方面的实践经验

- 如果你的大学课程没有提供足够的相关课程,可以通过选修与人工智能伦理相关的特别课程来充实你的简历

- Check out job portals such as Indeed, Simply Hired, Glassdoor, AI-Jobs.net, and The AI Job Board

- 注意招聘启事中列出的教育和经验要求,并记下可在简历中重复使用的关键词。关键词可包括

- 人工智能审计

- 人工智能技术

- 解决冲突

- 批判性思维

- 跨职能合作

- 数据隐私和安全

- 决策

- 新兴技术

- 伦理分析

- 制定道德框架

- 解决问题

- 项目管理

- 遵守法规

- 研究与评估

- 风险评估

- 透明度和问责制

- Check out online AI Ethicist resume templates and review potential job interview questions

- 向学校的就业中心咨询,以获得撰写简历、进行模拟面试、学习如何着装以获得面试成功的帮助,以及寻找招聘会的帮助。

- 向在职的人工智能伦理学家请教求职秘诀!

- 向你的学术顾问、教授和导师请教有关开创事业的建议

- 让你的关系网知道你在找工作!大多数工作仍然是通过熟人找到的,因此请开始利用你的社交资本!

- Relocate to where the jobs are. Per Versa Networks, the top states hiring the most in AI are: California, Texas, New York, Washington, Virginia, and Massachusetts

- 请求允许在求职申请中将某人列为个人推荐人

- 在 LinkedIn 上建立个人档案,开始撰写有关人工智能伦理的文章!

- Understand the importance of proper AI model training, and the consequences to businesses when things go wrong. Google's parent company Alphabet lost $100 billion in market value practically overnight when its Bard chatbot debuted…and gave wrong answers.

- Meanwhile, Bing had to reign in its AI after it developed a strange alter ego named “Sydney”

- 遵循并认真记录程序,确保一致性和准确性

- 询问你的雇主,你可以提高哪些技能来更好地满足他们的需求。这可能是一个更高级的学位,也可能是一个证书,或者只是一些额外的课程。

- 展示高尚的道德价值观、诚信和商业头脑

- 与同伴有效合作,但不要屈服于同伴的压力。专注于解决问题

- 全面培训新的伦理学家,但也要倾听他们的观点。保持开放的心态,因为这一领域有许多主观因素(毕竟它植根于哲学!)。

- 与专业组织保持联系,了解最新突破。人工智能发展日新月异,世界各地的团队正努力将其推向更高水平

- Don’t just focus on today’s problems. Forecast growing or potential issues which could arise and plan for contingencies!

随着人工智能的不断发展,人类应该如何对待它?人工智能最终会达到具有自我意识的程度吗?如果是这样,我们会相应地对待它......还是仅仅把它当作一个程序而不是一个有生命的创造物来利用?

Science fiction authors have long obsessed over such questions. From Isaac Asimov’s I, Robot novel to Star Wars’ discriminatory treatment of droids such as C-3PO, the outlook for AI life forms is often portrayed as bleak. Star Trek: The Next Generation explored this ethical frontier in great detail in the episode “The Measure Of A Man,” in which the ship’s Captain Picard had to “prove Data [a self-aware android] is legally a sentient being with rights and freedoms under Federation law…”

网站

- 埃森哲

- 立即访问

- ACM

- 阿达-拉芙蕾丝研究所

- 适应

- AI4ALL

- 人工智能伦理研究所

- Now 人工智能研究所

- 人工智能专业人员协会

- Anch.AI

- 算法正义联盟

- 阿兰-图灵研究所

- 算法观察

- 艾伦人工智能研究所

- 计算语言学协会

- 计算机械协会

- 人工智能促进会

- Atomium

- Baidu, Inc.

- 巴德

- 伯克利法律与技术中心

- 必应人工智能

- 剑桥数据中心促进数据驱动的发现

- 人工智能与数字政策中心

- 种族批判与数字研究中心

- 数据创新中心

- 人类兼容人工智能中心

- 人类技术中心

- 信息技术政策中心

- 互联网与社会中心

- 存在风险研究中心

- 民用基础设施平台

- 消费技术协会

- 大数据、伦理与社会理事会

- 课堂

- DARPA

- 数据道德

- 数据正义实验室

- DeepLearning.AI

- 电子前沿基金会

- 伦理网

- 欧洲人工智能协会

- Fast.ai

- 联邦贸易委员会--技术研究与调查办公室

- 人类未来研究所

- Future of Life Institute

- 隐私权的未来论坛

- 未来社会

- 全球灾难风险研究所

- 基因组

- 治理实验室

- IEEE

- IEET - 伦理与新兴技术研究所

- IFTF - 未来研究所

- 人工智能与机器学习伦理研究所

- 国际模式识别协会

- 国际神经网络学会

- 学习提示

- 利弗霍姆未来智能中心

- 机器智能研究所

- 微软

- 麻省理工学院-CSAIL 计算机科学与人工智能实验室

- 内斯塔

- NIST

- 国家人工智能安全委员会

- 经合组织人工智能政策观察站

- OpenAI

- 开放数据研究所

- 人工智能合作伙伴关系

- 马里兰大学的 PERVADE

- 国际隐私权组织

- ProPublica

- 普华永道

- RightsCon

- 机器人产业协会

- Salesforce - 爱因斯坦人工智能

- Software.org

- 斯坦福大学 HAI

- 技术政策实验室

- 乌德姆

- 犯罪司法所人工智能和机器人中心

- 世界经济论坛

书籍

- AI Ethics (The MIT Press Essential Knowledge series), by Mark Coeckelbergh

- Ethics of Artificial Intelligence, by S. Matthew Liao

- Oxford Handbook of Ethics of AI, by Markus Dubber, Frank Pasquale, and Sunit Das

成为人工智能伦理学家的道路并不像大多数职业那样一目了然。随着人工智能技术的不断进步,情况可能会发生更大的变化。如果你想从事与技术相关的工作,但又想考虑一些其他选择,请查看以下选项!

- 人工智能提示工程师

- 大数据工程师

- 商业智能开发人员

- 计算机硬件工程师

- 计算机程序员

- 计算机系统分析员

- 数据库架构师

- 数据科学家

- 信息安全分析师

- 数学家

- 机器学习工程师

- 机器人工程师

- 软件工程师

- 软件架构师

- 网络开发员

新闻联播

特色工作

在线课程和工具

年薪预期

New workers start around $67K. Median pay is $104K per year. Highly experienced workers can earn around $152K.